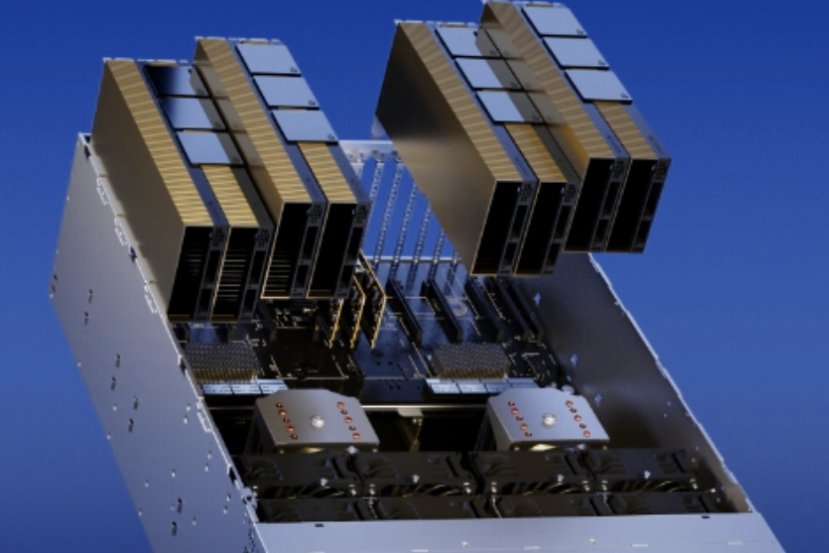

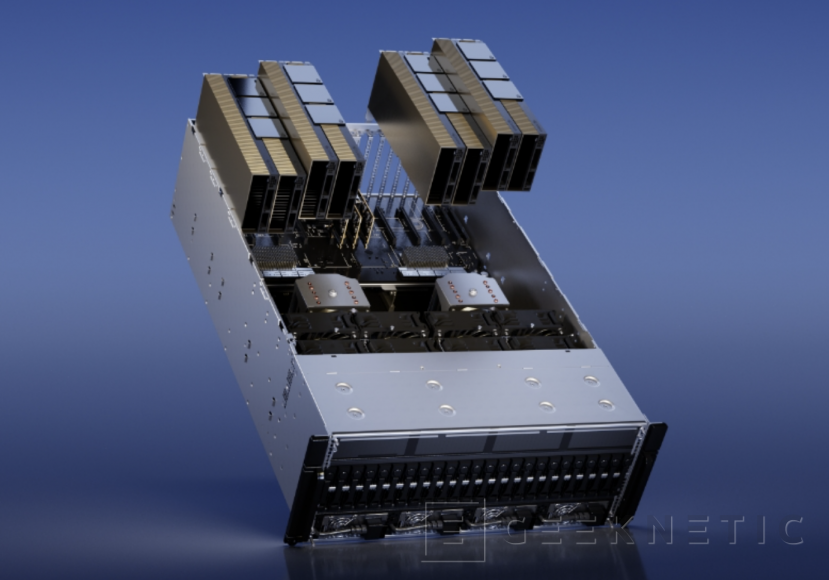

Anunciadas en el GTC del pasado año 2022, las GPUs NVIDIA Hopper H100 son una de las soluciones más potentes de la compañía para tareas de cómputo. Dotadas de Tensor Cores de cuarta generación y la tecnología NVLink, consiguen una interconexión entre varias GPUs a 900 GB/s de ancho de banda.

Desde hoy mismo, uno de los proveedores de servidores cloud del mundo, Amazon, ha anunciado que ya ofrece instancias de sus servidores dotados de estas potentes GPUs de alto rendimiento en sus Amazon Web Services (más conocidos mundialmente como AWS). En concreto, son las instancias Amazon EC2 P5 las que ofrecen las H100 orientadas a cálculos de alto rendimiento y aplicaciones orientadas hacia la aceleración de Inteligencia Artificial mediante entrenamientos de modelos neuronales y también para aplicar la inferencia resultante.

Como es habitual en las instancias AWS, todo se gestiona desde el propio panel web del servicio y permite a los usuarios configurar sus máquinas e incluso crear clústeres HyperScale para distribuir los cálculos entre varias instancias, con velocidades de 3.200 Gbps a través de red.

En total, Amazon permite escalar hasta 20.000 GPUS H100.

Los precios del servicio dependerán de las configuraciones que escoja cada cliente de AWS, pudiendo adaptarlas a sus necesidades de cada momento.

Fin del Artículo. ¡Cuéntanos algo en los Comentarios!

ESCRÍBE UN NUEVO COMENTARIO ¿Qué opinas sobre este tema? ¿Alguna pregunta?

Se enviará como Anónimo.